华为不能够用whatsapp

X因未经同意利用欧盟用户数据训练Grok大模型事件有了最新进展。爱尔兰数据保护委员会(DPC)周四(8 月 8 日)表示,马斯克旗下的X平台已同意,在法庭未对此案作出判决之前,暂停使用欧盟和欧洲经济区部分用户公开帖子的个人数据来训练人工智能(AI)模型Grok。

用户输入及反馈数据在大模型能力优化方面具有重要价值,也是各个科技公司想要挖掘的“金矿”。但在严格的个人信息保护监管约束下,科技公司虽有利用用户交互数据的原始动力,但又想获得“免责”牌,于是纷纷在隐私政策上打算盘,想通过隐私政策隐秘地、合法地利用用户数据训练大模型。

21世纪经济报道记者注意到,过去一年多时间内,Meta、Adobe、谷歌等科技公司纷纷更新隐私政策以期合法使用用户输入数据,然而均遭到舆论反弹并引起监管注意。

人工智能时代,如何在数据开发和个人信息保护之间寻求平衡,用户的数字主权如何得以保障,合理的合规模板应该是什么模样?或许是未来常谈常新的课题。

该事件的起因可追溯于今年7月,一名X用户发现,X在未事先获得用户明确同意的情况下,“自动选择”将其帖子以及与 xAI 旗下 Grok 聊天机器人的互动用于“训练和微调”xAI 系统。更加引起用户不满的是,拒绝数据使用的设置入口十分复杂,难以被用户轻易发现。这进一步激起用户对隐私保护的担忧和对X平台的质疑。

消费者组织于周一(8月5日)向爱尔兰数据保护委员会(DPC)提交了一份投诉,指控X公司的人工智能(AI)工具违反了《通用数据保护条例》(GDPR)。投诉关注的焦点在于X平台缺乏明确的法律依据,用户无法通过简单直接的方式从X的隐私政策中了解使用用户数据训练人工智能的法律依据。而且,用户行使反对权的程序十分繁琐复杂。

GDPR规定,公司若要收集或使用个人数据,首先需获得个人同意,并披露公司采取此举的原因。X平台若违反此规定,或许将面临其全球年度营业额4%或2000万欧元的重罚。

X 全球政府事务部在8月7日的回应中表示,DPC的命令是没有根据的、过于宽泛的,而且在没有任何理由的情况下单独针对X,并认为这会影响到X在欧盟提供服务的能力。至于投诉关注的焦点,X并未回应,而是顾左右而言他。

其实,爱尔兰数据保护委员会(DPC)已经和X进行了长达数月的交涉,DPC还根据2018年的《数据保护法》第134条向高级法院提出紧急申请,才达成了暂停使用部分用户公开帖子的个人数据来训练AI的协议。

早在去年9月,X就已经陷入侵犯用户隐私的争议漩涡之中:彼时X突然更新了隐私政策,在2.1条款明确写道:“我们可能会使用收集到的信息和公开可用的信息来帮助训练我们的机器学习或人工智能模型。”

这意味着一旦在X上发帖创作内容,就会被拿去喂AI。埃隆-马斯克对此回应称,X只会使用公开数据训练人工智能模型,不会使用任何私有内容。

用户交互数据、输入及反馈数据等在模型能力优化、交互质量提升方面具有价值。在scaling law原则驱动下,科技公司有从用户数据中“掘金”的原始动力。

今年6月,Meta 更新隐私政策称,如果你在 Facebook、Instagram、Threads 或 WhatsApp 上发帖或与聊天机器人互动,Meta 将有权从当地时间 6 月 26 日开始使用你的数据,来训练其生成式人工智能模型。

同期,Adobe更新的隐私政策也提及,Adobe可能会以自动或人工的方式访问用户的内容,并且还可能会免费访问那些加密的隐私内容。如果用户不同意这条条款,相关的功能就会被锁定,用户将无法使用。

国内方面,2023年11月,办公软件WPS更新隐私政策称, “我们将对您主动上传的文档材料,在采取脱敏处理后作为AI训练的基础材料使用”。也引起了广泛的质疑,随即以公司致歉收尾。

一方面想伸手拿用户交互数据华为不能够用whatsapp,另一方面又想获得“免责”牌,科技公司们纷纷在隐私政策上打算盘,想通过隐私政策隐秘地、合法地利用用户数据训练模型。

上述Meta更新的隐私政策引起了欧洲监管机构的反对,Meta被欧盟勒令暂停使用欧盟用户数据训练AI大模型,受此影响,Meta无限期推迟原计划在欧洲推出的Meta AI聊天机器人。

今年1月份,美国联邦贸易委员会(FTC)在官网明确,未能遵守对用户和客户的隐私承诺的大模型公司可能会承担责任。

FTC称,如果公司选择保留或使用消费者数据用于其他目的而没有提供明确和显眼的通知并获得肯定的明确同意— — 例如,偷偷更改其服务条款或隐私政策,或将披露内容隐藏在超链接、法律术语或小字中— — 他们就有可能触犯法律。

一边是强烈的数据需求,另一边又是越发细化的个人信息保护。监管关注以及舆论压力,科技公司想堂而皇之拿用户数据训练AI并非易事。左右互搏之下,距离合适的合规方案仍有一段距离。

21世纪经济报道记者注意到,目前来看,基本上各个科技公司都会在隐私政策中设计相应条款注明利用用户交互数据的渠道。

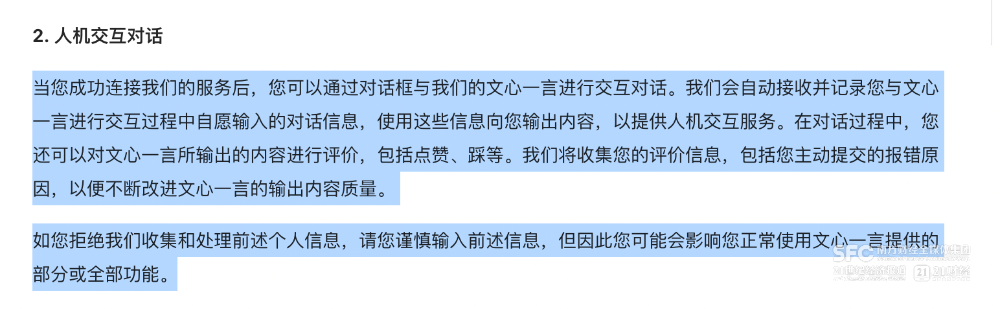

以文心一言等为例,会收集交互数据来改善模型,提醒用户谨慎数据个人信息,如若拒绝,会影响部分功能使用。

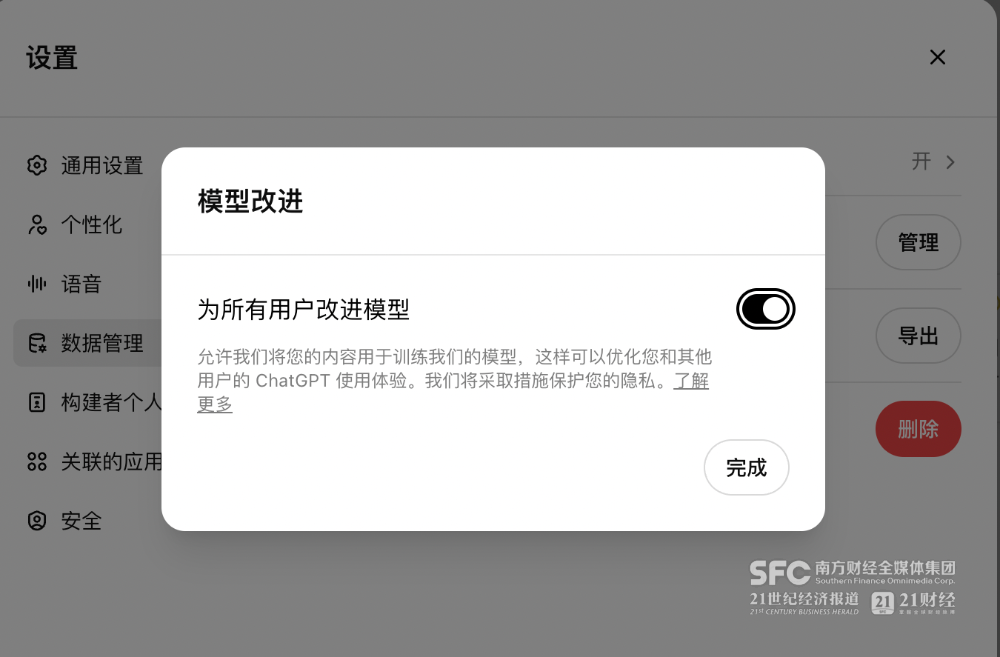

而合规模式最领先的是Claude,其采取默认不同意的方式,即默认情况下,Claude不会使用用户输入的内容训练模型,只有在三种例外情况下才会进行训练。